Voici le deuxième volet francophone d’une série de Guides essentiels publiés par First Draft. Chacun de ces livres est pensé comme un point de départ pour explorer les défis du journalisme digital de notre ère de désordre informationnel: collecte d’informations, vérification, journalisme éthique et responsable, sécurité en ligne, publicités digitales etc. Ces guides sont aussi un socle pour notre nouvelle initiative CrossCheck, qui vise à développer la collaboration entre journalistes à travers le monde.

L’extrait suivant provient du “Guide de First Draft pour la collecte d’informations et la veille sur le web social”, écrit par Carlotta Dotto, datajournaliste senior et Rory Smith, responsable de recherches, tous deux chez First Draft.

Ce guide a été adapté, pour sa version française, à des exemples plus pertinents pour un environnement francophone. Ces adaptations sont proposées par Seb Cubbon, analyste chercheur chez First Draft, et par moi-même.

Téléchargez le guide complet:

Comment collecter des informations et faire de la veille sur le web social?

Quels que soient vos sujets d’intérêt ou votre domaine, comprendre comment utiliser le web social pour découvrir, suivre et rechercher des sujets sont des compétences essentielles. Vous pouvez y trouver des sources, suivre des conversations, comprendre des comportements, suivre des événements et identifier les problèmes qui touchent une communauté. Savoir où, quand et comment chercher en ligne reste un prérequis. Dans ce guide, nous attirons votre attention sur les meilleurs outils et techniques gratuits de collecte d’informations (recherche active) et de veille (recherche passive). Nous examinons également les bonnes pratiques et fonctions des principales plates-formes et services en ligne pour que vous puissiez en extraire les contenus les plus utiles pour vos reportages et vos recherches. La vérification des informations et des sources que vous trouvez reste essentielle. Nous abordons ce point dans un autre guide (en anglais pour l’instant).

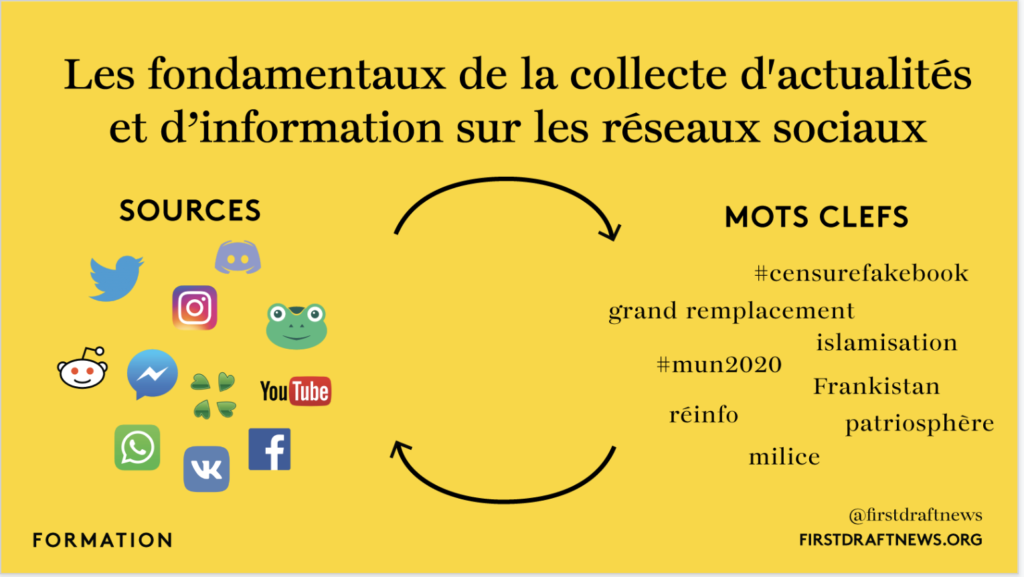

Il existe quelques concepts fondamentaux pour toute opération de collecte d’informations en ligne. Nous les abordons plus en détail dans ce guide mais il est utile de commencer par une brève présentation. Comme pour le journalisme avant Internet, les listes actualisées de sources pertinentes pour chaque domaine d’intérêt sont primordiales. Contrairement à l’ère pré-numérique, nous pouvons désormais écouter des millions de conversations en temps réel. C’est là qu’interviennent les recherches de mots-clés, termes, phrases ou hashtags utilisés pour discuter de sujets ou d’événements. Ils nous aident à identifier de potentielles sources sérieuses pour un article.

Pour les sujets clés, les sources et les mots-clés pertinents peuvent être plus évidents. Un journaliste local doit connaître les dirigeants locaux, les experts du domaine, les politiciens, les organisations caritatives, les universitaires, les personnes influentes, les groupes de campagne, les témoins oculaires, les célébrités, les chefs d’entreprise et les services d’urgence, pour n’en citer que quelques-uns. S’ils étaient à l’affût des dernières nouvelles provenant de ces sources, ils pourraient vouloir être à l’affut des mots et des phrases comme ‘tirer’, ‘poignarder’, ‘crash’, ‘collision’, ‘attaque’, ‘assaut’, ‘coups de feu’, ‘couteau’, ‘pistolet’, ‘explosion’, ‘mort’, ‘corps’, ‘grave’, ‘critique’, ‘changer la vie’, ‘menace de mort’, ‘terroriste’, ‘extrémisme’, ‘victime’ ou ‘blessé’. Ensemble, ces processus d’identification des sources et des mots-clés constituent le cœur de la collecte d’informations en ligne.

Boucle de rétroaction entre mots-clés et facteurs de divergence. Sont affichées les plateformes sources utilisées par First Draft pour suivre les élections municipales françaises de 2020. Source : First Draft

Lorsqu’il s’agit de sujets de niche, se lancer s’avère parfois plus difficile. L’identification de certains mots-clés plus spécifiques nous aide à identifier davantage de sources, créant ainsi une boucle de rétroaction avec de nouvelles sources et de nouveaux mots-clés pour de nouvelles plateformes qui peuvent nous mettre à niveau en un rien de temps. Les types de sources et mots-clés pertinents diffèrent pour chaque sujet et chaque période, cependant l’approche de base reste la même.

La veille est un processus itératif nécessitant la collecte constante de nouvelles informations relatives aux sujets, sources et conversations que vous suivez. Au fur et à mesure de l’évolution de votre veille, vous ferez continuellement apparaître de nouveaux comptes, mots-clés et hashtags pertinents. Il peut être très utile de maintenir un document ou un tableau central où vous pouvez compiler ces informations et ajouter les nouveaux contenus au fur et à mesure de leur apparition. Vous gagnerez aussi du temps pour les veilles relatives à des thèmes similaires.

Notez qu’il n’existe pas de méthode unique pour organiser et gérer des recherches en ligne. La nature des sujets sur lesquels vous enquêtez dicte en grande partie les sources, mots-clés et processus nécessaires. Nous vous encourageons à être créatif et à rester flexible lorsque vous concevez vos propres systèmes de veille. Des outils puissants mais payants sont disponibles pour ce type de travail. Ce livre se concentre sur les outils gratuits et les techniques que toute personne disposant d’une connexion Internet peut utiliser pour la collecte d’informations et la veille sur le web social.

En 2017, First Draft a lancé un projet de journalisme collaboratif autour de la campagne présidentielle française, rassemblant 37 rédactions, partenaires technologiques et universitaires originaires de France, de Grande-Bretagne et de Belgique. Le référendum du Brexit et les élections présidentielles américaines de 2016 avaient fait naître un sentiment d’urgence au sein des médias, la désinformation se répandant dans les réseaux sociaux. Il existait un besoin conscient d’aborder les questions de confiance et de transparence entre les médias et leur public.

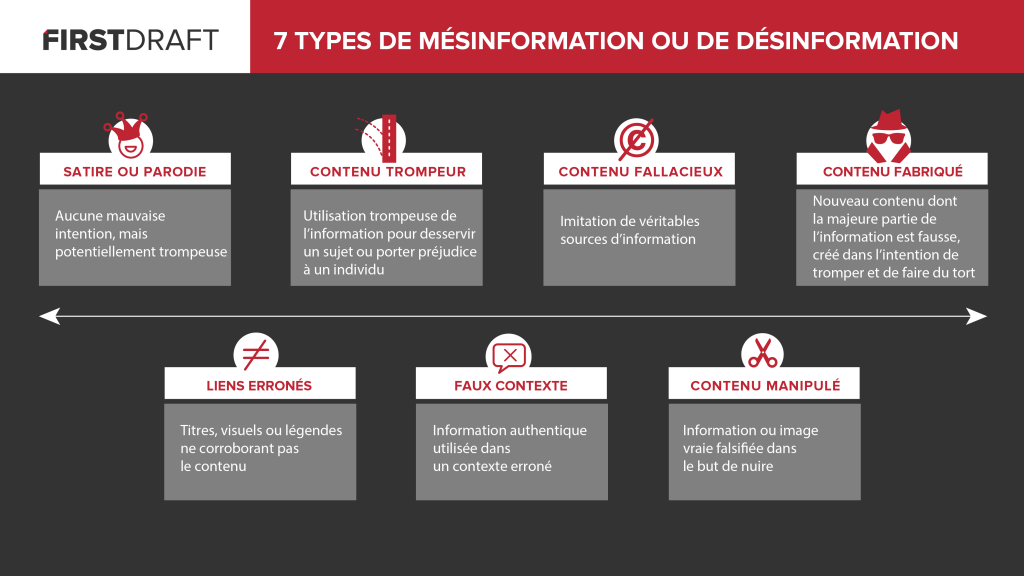

Plus de 100 journalistes répartis dans 33 rédactions ont ensemble surveillé le Web social. Ils ont collaboré sur 63 contenus « problématiques ». Conformément aux sept types de mésinformation et de désinformation de Claire Wardle, les journalistes ont évité de se limiter aux termes « vrai » et « faux », trop simplistes et souvent trompeurs, afin de mieux comprendre les outils et techniques utilisés par les créateurs de hoax et les propagandistes et de les signaler plus efficacement au public.

En novembre 2019, First Draft a mis en place une opération de veille pour enquêter à nouveau sur l’espace d’information en ligne français. Cette nouvelle phase, qui mène aux élections municipales de mars 2020, montre à quel point cette ère de désordre informationnel évolue rapidement et se complexifie. La nécessité de mieux se préparer et d’unir nos forces pour y faire face est plus évidente que jamais.

Certaines caractéristiques notoires de cet environnement informationnel ont persisté depuis 2017, inévitablement. La désinformation politique en ligne vise souvent à renforcer un petit nombre de narratifs récurrents, dont un grand nombre tournent autour du sentiment anti-immigration et de la perception de troubles sociaux.

De vieilles photos et vidéos sont encore souvent utilisées comme « preuves » pour étayer ces narratifs et provoquer de fortes réactions émotionnelles. Parmi les messages récents, on trouve une ancienne photo de confrontation policière (capture d’écran ci-dessous) et une vidéo d’Iran présentée comme représentant la police anti-émeute française. Ces exemples rappellent les désinformations découvertes en 2017, lorsqu’une crise de réfugiés en Turquie, ainsi que des images et des cartes, més-attribuées, accusant à tort les immigrants de crimes, ont été utilisées pour promouvoir des narratifs de troubles sociaux, de répression gouvernementale et d’immigration massive incontrôlée.

Photo prise en 2010, publiée à nouveau en septembre 2019. Capture d’écran par l’auteur.

Parmi les sources qui ont avancé des contenus problématiques en 2017, beaucoup sont restées actives et ces sites Web et comptes de réseaux sociaux bien suivis continuent d’influencer les communautés en ligne qui leur sont réceptives. Ils ont réussi à conserver leur rôle dans la sphère dite « patriotique » ou même « fachosphère », malgré des sources d’information reconnues qui détaillent l’étendue de leur tromperie.

Cependant, en moins de deux ans, ces tactiques ont évolué. Voici cinq exemples de développements significatifs que nous avons identifiés au cours de notre dernier projet de veille.

Plus de faux contexte, peu de fabrication

Les éléments fabriqués ou mal manipulés constituaient une partie, limitée mais non négligeable, des affirmations qui ont été vérifiées par CrossCheck en 2017. Des rumeurs non fondées visant à saper la crédibilité des candidats, des résultats de vote fabriqués à partir de narratifs portés par des comptes imposteurs et des photos mal manipulées utilisées pour générer des gros titres aptes à générer de l’attraction sont autant d’exemples de contenus fabriqués qui ont parfois fait surface à l’approche de l’élection présidentielle.

Peu de cas d’éléments fabriqués ont été relevés au cours de notre dernière période de veille, fin 2019. La plupart n’ont pas réussi à susciter beaucoup d’attention. La majorité des éléments de désinformation efficaces reposaient sur des conjectures subtiles et de fausses déclarations. Parmi les exemples récents, on peut citer des citations abrégées destinées à amplifier les réactions polarisantes de personnalités publiques controversées et des sondages d’opinion anciens qui nuisent aux hommes et femmes politiques.

Le faux contexte est maintenant utilisé de manière plus stratégique pour générer plus d’intérêt en ligne. Au cours des derniers mois de 2019, deux exemples remarquables ont émergé lorsque des informations obsolètes et incomplètes ont circulé à des moments précis, choisis afin de tirer profit des tensions existantes et de maximiser la tromperie.

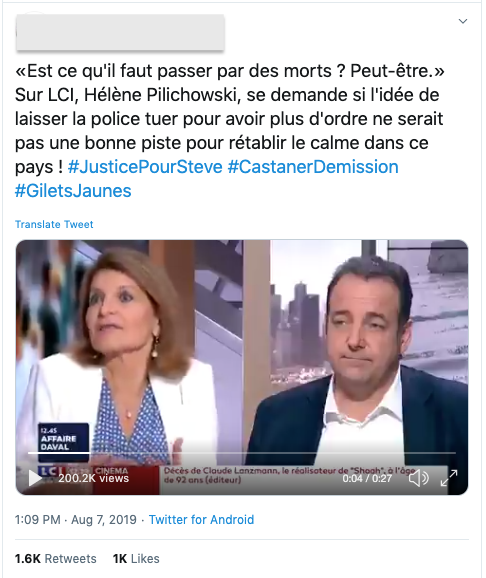

Dans un journal télévisé de 2018, une journaliste de la chaîne nationale LCI avait suggéré qu’il y avait peut-être « besoin d’un mort », pour rétablir les relations entre les manifestants et la police. Cette citation très controversée a été publiée à nouveau sur Twitter un an plus tard, mais, fait crucial, quelques jours seulement après la découverte du corps d’un jeune homme dont la disparition avait été liée à une violente intervention policière lors d’un spectacle de musique. Le message contenait des hashtags liés à l’affaire et ne comportait aucune indication de la date initiale de l’entretien, laissant croire à de nombreux utilisateurs en ligne que les commentaires étaient liés à l’affaire. Plusieurs sites Web d’information peu fiables, ainsi que des médias internationaux ont alors publié des articles qui utilisaient la citation comme titre sans mention de la date d’origine. Ils ont également été largement diffusés sur les réseaux sociaux. Le moment choisi pour la publication de ces messages a polarisé encore davantage les débats et controverses sur les violences policières et la partialité des médias en France.

Cette vidéo de 2018 est postée sur Twitter avec les hashtags « justice pour Steve », « Castaner démissionne maintenant », « Gilets jaunes ».

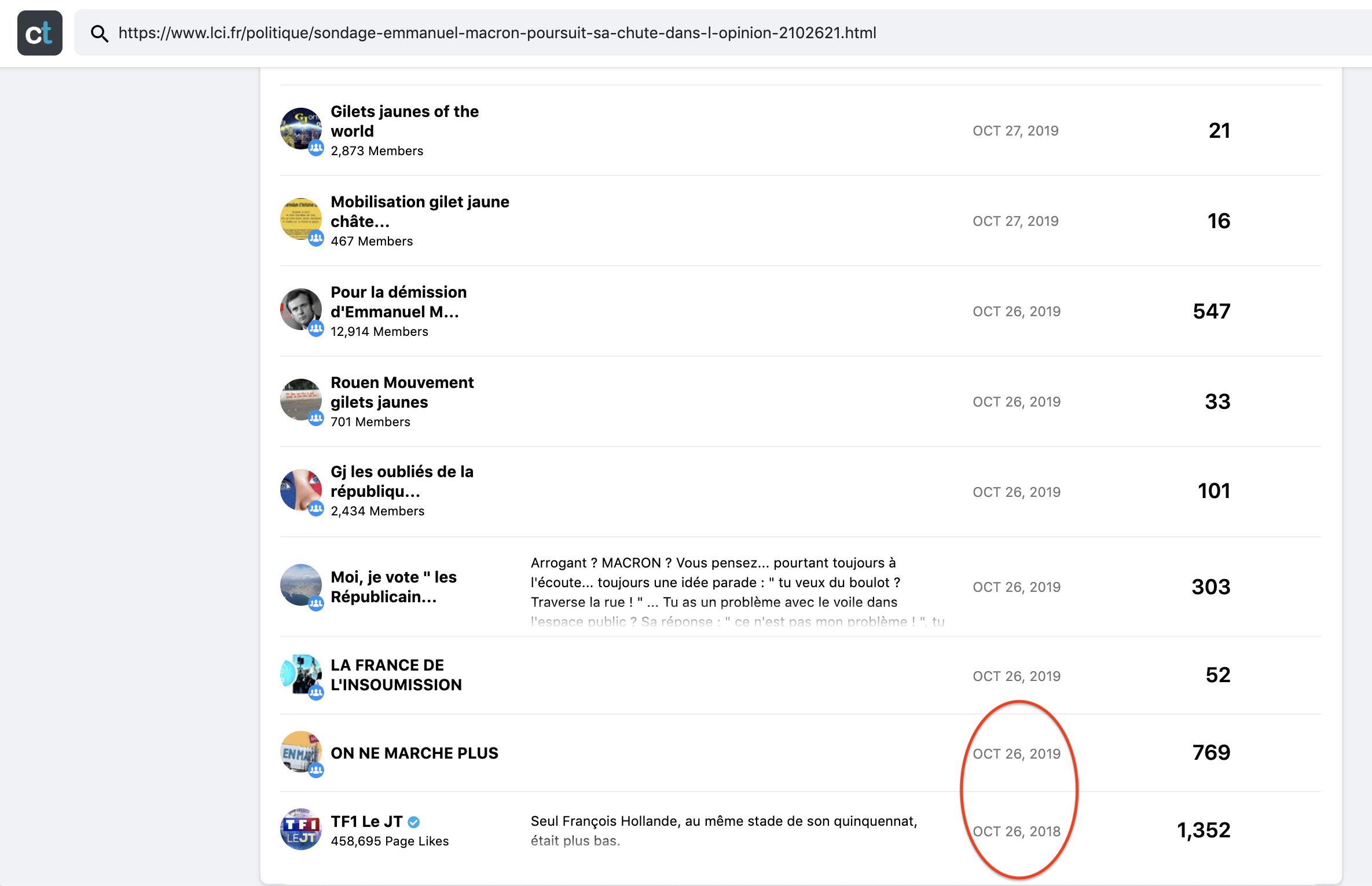

De même, un sondage d’opinion publié le 26 octobre 2018 a révélé que la cote de popularité de M. Macron était tombée à son plus bas niveau depuis son investiture. Ce jour-là, LCI a publié le sondage dans un article intitulé « Sondage d’opinion : jugé « arrogant », Emmanuel Macron poursuit sa chute dans l’opinion ». Cet article, dont la vignette ne comporte aucune indication sur sa date de publication lorsqu’il est partagé en tant que message sur un réseau social, a ensuite été re-publié sur six groupes Facebook exactement un an plus tard, le 26 octobre 2019.

La fonction LinkSearch de CrowdTangle est utilisée pour suivre les liens URL partagés sur les plateformes de réseaux sociaux. Capture d’écran par l’auteur.

Les messages contenant des liens anciens vers le sondage ont été publiés sur des dizaines de groupes Facebook totalisant plus de 350 000 membres et ont donné lieu à plus de 8 000 interactions au cours du mois suivant.

« Recyclage » des contenus et partage coordonné des liens

Plusieurs articles trompeurs ou inexacts qui ont été rapportés sur CrossCheck en 2017 avaient été diffusés par un certain nombre de sites d’information peu fiables. Des résultats de sondages més-attribués, des allégations sans fondement de censure politique et des rapports mensongers impliquant l’érosion de la culture française ont tous été amplifiés par un certain nombre de sources en ligne tout aussi peu fiables. Les liens entre ces sources en ligne sont souvent explicites : les « liens recommandés » et les « logos des partenaires » apparaissent en bas de la plupart de ces sites Web. Les éléments identifiés par notre dernier projet de veille en 2019 suggère que ces réseaux recyclent les contenus plus fréquemment et sont devenus moins dépendants de leurs propres contenus originaux.

Dans les trois cas mentionnés ci-dessus, chaque site Web avait produit son propre contenu original autour de l’histoire. Dans le cadre du projet de veille de 2019, la plupart des mésinformations sous forme d’articles en ligne avaient été amplifiées par de nombreux sites Web, souvent simplement copiées ou abrégées d’un site Web à l’autre. Une citation abrégée et hors contexte d’un article coécrit par Greta Thunberg, par exemple, a fait l’objet de trois versions différentes de l’article, des copies identiques de chacune d’entre elles étant utilisées par au moins trois sites Web distincts.

Plusieurs sites Web publiant des histoires identiques en utilisant comme titre une citation abrégée.

Un tel « recyclage » des contenus peut renforcer la désinformation en augmentant sa portée, tablant sur le fait que la multiplicité des écrits autour d’une même question peut contribuer à créer une illusion de valeur médiatique et, par conséquent, de crédibilité.

En outre, certains réseaux de désinformation diffusent désormais leur contenu de manière plus coordonnée sur les réseaux sociaux principaux. Notre veille de 2019 a identifié des liens d’articles provenant de plusieurs nouveaux sites de « ré-information », diffusés sur un certain nombre de pages et de groupes Facebook en quelques minutes. Des articles provenant de ces sources, y compris des citations manipulées et démystifiées (capture d’écran ci-dessous), ou des contenus satiriques reconvertis ont été publiés sur une demi-douzaine de pages et de groupes en moins de quatre minutes. Une enquête conjointe du journal Le Monde et du EU Disinfo Lab a révélé que ces sites faisaient partie d’un réseau étranger de faux comptes.

Une fausse déclaration suggérant que la secrétaire d’État Mme Schiappa voulait interdire la diffusion des cérémonies religieuses à la télévision. Capture d’écran par l’auteur.

Ces tactiques ont également été observées récemment dans d’autres sphères en ligne. Des chercheurs de l’université d’Urbino ont constaté que de nombreux réseaux de Groupes, Pages et profils publics sur Facebook avaient diffusé des liens de manière coordonnée pendant la campagne électorale de 2018 et les élections européennes de 2019 en Italie.

De telles tactiques pourraient se multiplier lors des prochains cycles électoraux, car l’étude a montré qu’en moyenne, les liens partagés de manière coordonnée génèrent plus d’interactions que les autres.

Militarisation du contenu satirique

En 2017, cinq articles satiriques avaient été vérifiées par CrossCheck après qu’un certain nombre d’utilisateurs aient pris leur contenu au sérieux. Le caractère satirique des sources était souvent facile à repérer, soit par leur nom, comme le jeu de mots Le Gorafi en lien avec Le Figaro, soit par le type de contenu hébergé sur leur site Web. Dans l’un des cas, un site de canulars a été utilisé pour fabriquer une proposition politique controversée « mise en avant » par le candidat de l’époque, Emmanuel Macron.

La satire continue de jouer un rôle majeur dans les conversations politiques en ligne: ce rôle est essentiel tant que tous comprennent l’aspect humoristique du propos. Cependant, il semble que le contenu satirique en ligne fasse aujourd’hui l’objet d’une utilisation plus concertée et plus ciblée que dans les exemples qui avaient été observés dans le projet CrossCheck en 2017.

Un site Web satirique créé en avril 2019 qui imite le nom et le logo de France TV a vu deux de ses articles se propager, l’un d’eux générant presqu’un demi-million d’interactions sur Facebook. L’apparence trompeuse et l’humour subtil des articles (une « citation » fabriquée, mais que certains pourraient juger crédible du président Macron) ont été utilisés pour polariser davantage le débat sur la présidence de Macron. Les utilisateurs ont diffusé ces liens sur de nombreux groupes Facebook avec des légendes à caractère émotionnel qui suggéraient que la citation était authentique. Certains messages contenant des légendes identiques ont été partagés en rafales. Certains ont atteint jusqu’à quatre groupes en 16 secondes, selon les données de CrowdTangle. En outre, l’un des sites de désinformation faisant partie d’un réseau de sources d’information non authentiques a copié l’article satirique et l’a publié en même temps que d’autres articles non satiriques. Ce lien a ensuite été diffusé simultanément sur les Pages publiques et les Groupes Facebook (5 en moins de 4 minutes) avant de circuler sur de nombreux autres sites plus tard dans la journée.

Au cours des derniers mois, la satire a également été utilisée pour cibler et discréditer certains hommes et femmes politiques. Un compte Twitter de parodie plaisantait sur le fait que la porte-parole du gouvernement, Sibeth N’Diaye, soutenait un politicien de haut niveau, qui avait récemment été reconnu coupable d’activités frauduleuses en postant une citation fabriquée de toutes pièces. Le tweet a été capturé et recadré pour masquer la nature satirique de la source. Ce visuel manipulé a ensuite été largement diffusé sur Facebook par le biais de messages comportant des légendes incendiaires. De même, une autre citation forgée de toutes pièces à partir d’un site Web satirique « desourcesure » se moquant de Mme N’Diaye a été utilisée pour créer un mème qui a ensuite été largement diffusé sur les réseaux sociaux. Le mème comportait également la phrase « qui a voté pour cela ? », dans une tentative évidente de provoquer une réaction émotionnelle. Dans les deux cas, de nombreux utilisateurs ont réagi avec des émoticônes « en colère » et de nombreux médias ont publié des vérifications de faits connexes.

Photo contenant une citation satirique forgée de toutes pièces, mais recadrée pour cacher la nature satirique de la source. Elle est accompagnée de la légende « S’il vous plaît, faites-la taire !! ». Capture d’écran par l’auteur.

L’utilisation de citations forgées de toutes pièces sur des images pour cibler les personnes de couleur dans les fonctions publiques reflète l’évolution de la situation à l’approche des élections de 2019 au Royaume-Uni, où des tactiques identiques ont été employées pour nuire aux candidats.

Ces mèmes et images superposés au texte sont devenus un outil de désinformation de plus en plus courant et présentent des défis singuliers pour le public en ligne et les journalistes.

Mèmes et textes sur images

À l’exception de ce lien d’article qui présentait une image sous forme de vignette, aucun texte sur images trompeur ou inexact n’a été signalé par CrossCheck en 2017. En revanche, peu de jours passent pendant le projet de veille de 2019 sans que des mèmes ou des images trompeuses ne soient diffusés en ligne. Les images qui comprennent des citations forgées de toutes pièces, des statistiques exagérées et un langage incendiaire ont montré qu’il est possible de provoquer de fortes réactions émotionnelles et de renforcer encore les convictions des individus au cours de ces derniers mois. Ces types de messages, qui étaient également un élément-clé de la désinformation en ligne lors des élections générales britanniques de l’année dernière, sont notoirement rapides et faciles à réaliser, mais peuvent être difficiles à suivre et à signaler.

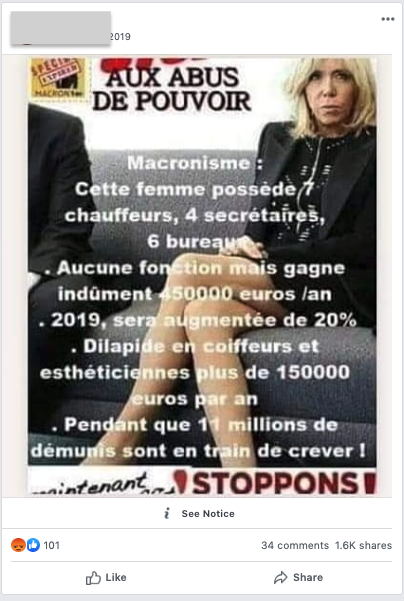

Des statistiques inexactes et trompeuses superposées à une photo de Brigitte Macron. Capture d’écran par l’auteur.

Les techniques et outils s’appuyant sur du texte pour surveiller le Web social sont pour la plupart inefficaces, car ces images sont souvent partagées sans légende. En outre, les outils qui permettent de suivre la circulation des contenus en ligne peinent à saisir des données précises pour les images manipulées ou éditées.

Une solution possible est l’extension de navigateur Project Naptha qui peut aider à extraire du texte d’une image. Le texte peut alors être utilisé pour essayer de déterminer si des informations identiques ont été partagées ailleurs, mais les résultats sont généralement rares.

Des recherches ont montré que les déclarations ont plus de chances d’être crues lorsqu’elles sont présentées à l’aide d’images. Comme celles-ci deviennent un outil de plus en plus courant pour diffuser la désinformation, il est plus que jamais essentiel de prendre en compte le mobile des sources quand elles utilisent l’imagerie pour promouvoir une opinion politique.

Plateformes alternatives

Les plateformes de réseaux sociaux « grand public », notamment Facebook et Twitter, sont toujours le lieu de la majorité des conversations politiques en ligne en France. Ces espaces restent donc les principaux champs de bataille pour les agents de la désinformation. Depuis 2017, ces plateformes jouent un rôle plus actif pour répondre à la diffusion de la désinformation en ligne. Des mesures telles que des politiques plus strictes en matière de modération des contenus et des comptes ainsi que des partenariats pour la vérification des faits par des tiers ont rendu ces plateformes plus hostiles aux agents de désinformation. Les rapports sur les retraits à grande échelle de faux comptes sont désormais presque hebdomadaires.

Au cours des deux dernières années, de nombreux sites d’influence et de désinformation au sein des communautés en ligne françaises ont cherché à encourager la diffusion de leurs contenus par le biais de plateformes alternatives, en grande partie non censurées. Dans plusieurs cas, ils ont créé leurs propres comptes pour diffuser leur contenu sur ces chaînes. Certaines sources opèrent désormais exclusivement par le biais de ces canaux après avoir été totalement bannies des plateformes grand public.

Plus précisément, VKontakte (communément appelée « VK ») et l’application de messagerie directe « Telegram » sont de plus en plus utilisées par les sources et les communautés françaises en ligne qui se plaignent souvent de censure du contenu. VK s’est développée pour accueillir des dizaines de groupes francophones dont certains comptent plusieurs milliers de membres. Telegram compte un nombre similaire de « chaînes publiques françaises d’information », bien que leur nombre d’abonnés soit plus limité – souvent moins d’un millier. Les liens vers les comptes VK et Telegram et les boutons « partager » se trouvent maintenant souvent sur les sites français de désinformation les plus populaires, alors que ceux-ci se limitaient souvent à Facebook, Twitter et YouTube en 2017.

Bien que nous ayons trouvé peu de preuves que des sources de désinformation partagent du contenu exclusif sur ces plateformes, plusieurs cas de désinformation qui ont fait surface sur Facebook circulaient également sur les groupes publics VK et les chaînes Telegram. En octobre 2019, le Rassemblement National a annoncé le lancement de sa propre chaîne Telegram, ce qui laisse entendre que les sources d’information en ligne peu fiables ne sont pas les seules à reconnaître le potentiel de ce moyen de communication.

Le candidat du Rassemblement National, Jordan Bardella invite les utilisateurs à suivre la nouvelle chaîne Telegram du parti. Capture d’écran par l’auteur.

Cette tendance n’est en aucun cas limitée à la France. Des plateformes telles que Gab, Bitchute et Brighteon continuent d’attirer des communautés qui partagent des contenus considérés comme promouvant des points de vue plus « extrêmes ». Les caractéristiques de ces plateformes posent de sérieux problèmes de sécurité et d’éthique pour les journalistes et les chercheurs. Cependant, à mesure que l’importance de ces plateformes augmente, le besoin de comprendre comment ces sphères numériques fonctionnent et comment elles peuvent affecter l’écosystème de l’information au sens large se fait sentir.

Avec le premier tour des élections municipales qui approche à grands pas et un climat permanent de contenu à forte charge émotionnelle et partisane sur les réseaux sociaux, la désinformation en ligne pourrait jouer un rôle encore plus important dans le débat politique. Alors que les tactiques utilisées pour diffuser des contenus trompeurs continuent d’évoluer, les électeurs doivent rester vigilants lorsqu’ils naviguent sur le Web social.

Marie Bohner a aussi contribué à cet article.

Restez en lien avec le travail de First Draft en vous inscrivant pour notre newsletter (en anglais) et en nous suivant sur Facebook et Twitter.

Voici le premier d’une nouvelle série de Guides essentiels publiés par First Draft. Chacun de ces livres est pensé comme un point de départ pour explorer les défis du journalisme digital de notre ère: collecte d’actualités, vérification, journalisme responsable, sécurité en ligne, pubs digitales etc. Ces guides sont aussi un socle pour notre nouvelle initiative CrossCheck, qui vise à développer la collaboration entre journalistes à travers le monde.

L’extrait suivant provient du “Guide de First Draft pour un journalisme responsable dans une ère de désordre informationnel”, écrit par Victoria Kwan, Responsable pour l’éthique et les standards chez First Draft.

Téléchargez le guide complet:

Qu’est-ce que le journalisme responsable dans une ère de désordre informationnel?

De nombreuses rédactions possèdent des chartes éditoriales et déontologiques qui demandent à leurs collaborateurs de rapporter la vérité, établir les faits correctement, travailler de manière indépendante et impartiale, faire preuve de transparence avec leurs sources, reconnaître leurs erreurs et les corriger rapidement.

Ces principes fondamentaux constituent toujours la base du journalisme. Toutefois, à mesure que l’audience devient hyper-connectée, les innovations technologiques multiplient les moyens de recueillir et de diffuser des informations. En réponse, les agents de la désinformation font preuve d’une inventivité croissante pour manipuler les journalistes, les réseaux sociaux et, ainsi, l’attention des médias. Par conséquent, les rédactions se trouvent confrontées à une multitude de nouveaux défis éthiques, liés spécifiquement à ce phénomène d’amplification.

Intéressons-nous aux situations suivantes :

- Un journaliste recueille des informations pour un reportage sur un site Internet de désinformation dont un éminent politicien a fait la promotion en ligne. Le créateur du site a déclaré publiquement qu’obtenir l’attention des médias figure parmi ses objectifs. Comment le journaliste doit-il envisager la rédaction de son article ?

- Dans le cadre de la couverture d’un événement d’actualité majeur, un journaliste repère sur Twitter le message d’un témoin oculaire. Une petite, mais néanmoins véhémente communauté commence à faire circuler des théories du complot selon lesquelles le gouvernement serait à l’origine de l’événement. Après avoir vérifié la publication et l’identité du témoin, quels autres éléments le journaliste doit-il prendre en compte avant de retweeter le message ou de l’intégrer dans un contenu ?

- Suite à un violent attentat, un journaliste découvre que le suspect a publié des textes extrémistes sur un forum de discussion. Le journaliste doit-il publier un lien vers le texte, des captures d’écran, les deux ou ni l’un ni l’autre ?

- Un rédacteur en chef doit rédiger le titre d’un article portant sur une vidéo altérée. Le contenu a été ralenti pour qu’un politicien paraisse malade ou en état d’ébriété. Comment formuler le titre pour éviter l’amplification de ce mensonge ?

Dans tous ces scénarios, il n’existe pas une unique façon de procéder « correctement ». Le simple fait de réaliser un reportage comporte toujours un risque d’amplification et les rédactions doivent trouver l’équilibre entre l’intérêt public et les conséquences que peut entraîner l’attention médiatique.

À l’heure où les contenus trompeurs et mensongers polluent fortement l’écosystème de l’information, travailler de façon responsable implique pour les journalistes d’avoir conscience :

- de l’impact de leur travail sur les sources, les sujets et les lecteurs ;

- des conséquences de ce qu’ils écrivent et partagent en ligne qui, même sans faire partie d’un article à proprement parler, possède un potentiel d’amplification ;

- du rôle des médias dans l’écosystème pollué de l’information.

Ce guide n’est pas conçu pour fournir toutes les réponses. En revanche, il propose des questions à se poser face aux épineuses décisions que doivent prendre les journalistes dans ce monde de désordre informationnel.

Les chartes éditoriales et déontologiques contiennent généralement peu d’informations sur ces nouveaux défis. Nous vous recommandons de sélectionner certaines des questions posées dans ce guide et de les utiliser pour amorcer au sein de votre rédaction des discussions sur les bonnes pratiques à adopter pour couvrir ce type de sujets.

Traiter les contenus manipulés

L’expression « contenu manipulé » désigne un contenu original dont un élément a fait l’objet d’une modification.

Cela concerne souvent des photographies ou des vidéos. Les contenus visuels s’avèrent de puissants outils pour diffuser de la mésinformation ou de la désinformation, car les gens sont généralement plus enclins à à croire ce qu’ils voient10. En outre, les images manipulées se détectent plus difficilement que les textes qui véhiculent de la désinformation.

À titre d’exemple, en mars 2018, Teen Vogue a publié une vidéo montrant Emma González, une survivante de la fusillade du lycée de Parkland, déchirant une cible en deux12. Peu après la publication de cette vidéo, une version trafiquée a circulé où la jeune fille semble déchirer la Constitution des États-Unis.

La vidéo manipulée s’est rapidement propagée sur Gab, 4chan et Twitter.

At left is @tyler_mitchell’s photo of @Emma4Change for the cover of @TeenVogue. At right is what so-called “Gun Rights Activists” have photoshopped it into. #MarchForOurLives pic.twitter.com/jW6tTOv2Db

— pfpicardi (@pfpicardi) March 25, 2018

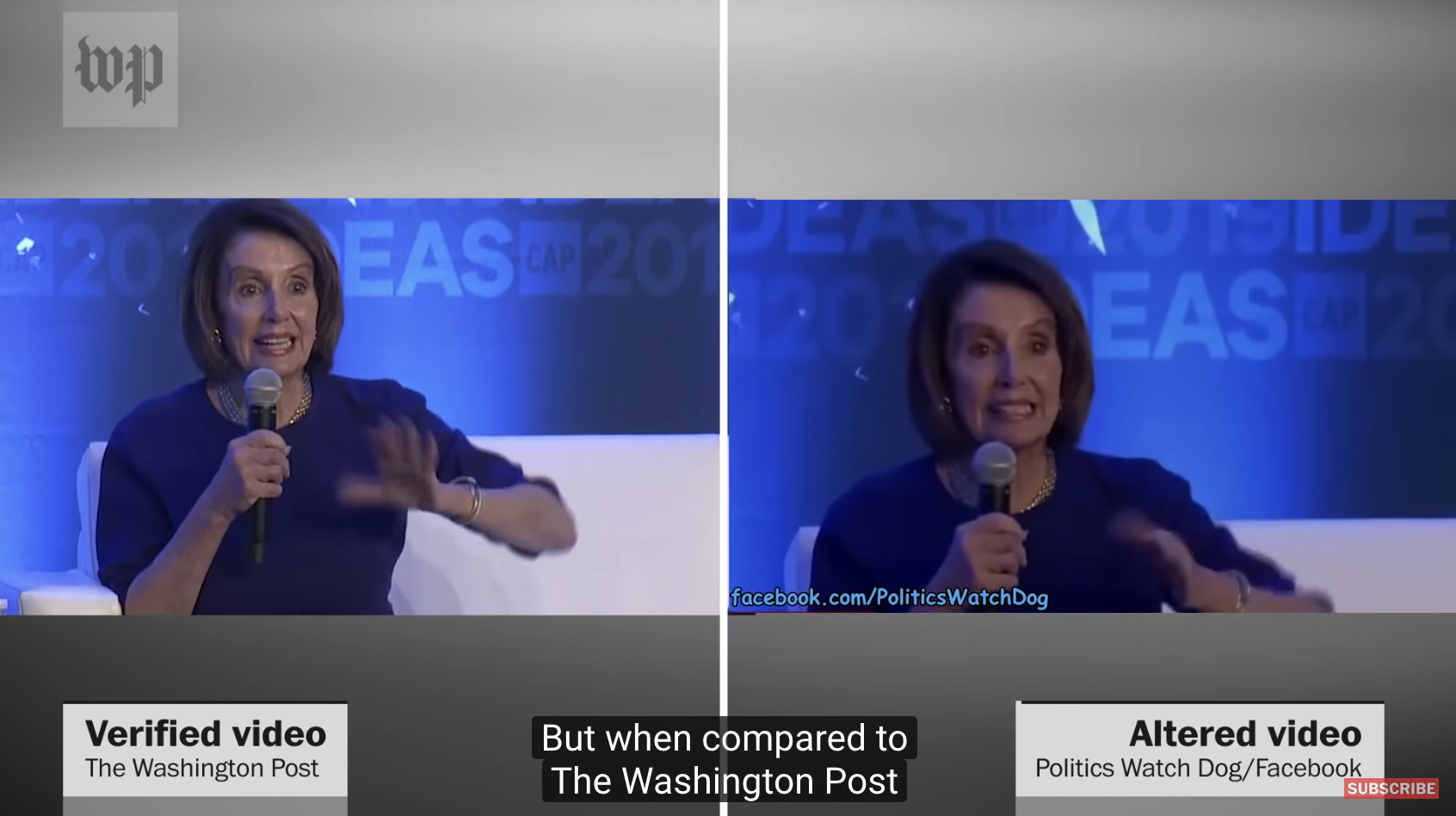

En mai 2019, un shallow fake (défini par First Draft comme une vidéo manipulée de mauvaise qualité) déformait des images de Nancy Pelosi, présidente de la Chambre des représentants aux États-Unis, pour la faire apparaître en état d’ébriété ou malade. Cette vidéo comptabilise des millions de vues sur les réseaux sociaux. Ci-dessous, une capture d’écran de la comparaison des vidéos présentée par le Washington Post.

La mise en parallèle des vidéos s’avère utile pour informer les lecteurs d’un contenu populaire qui relève de la désinformation. Incruster du texte bien visible peut accroître l’efficacité de la déconstruction en différenciant clairement la version originale de la version manipulée.

Les lecteurs remarquent mieux les couleurs vives et les textes de grande taille lorsqu’ils parcourent rapidement un fil d’actualité sur les réseaux sociaux.

This image of a "British Refugees Welcome" sign in Madrid has been doctored from a 2015 pic https://t.co/kLnCcnS2Ng pic.twitter.com/aSzUlosYL3

— First Draft (@firstdraftnews) June 27, 2016

Voici quelques éléments à garder à l’esprit lorsque vous travaillez sur des contenus manipulés :

- Au moment de décider de traiter ou non le contenu manipulé, il convient d’examiner dans quelle mesure et à quelle vitesse le contenu a été diffusé ainsi que d’évaluer la viralité et les retombées qu’il aura.

- S’il est décidé d’inclure une vidéo manipulée dans le sujet, vous pouvez choisir d’utiliser des extraits ou des images sélectionnées au lieu d’intégrer la vidéo originale ou d’inclure un lien vers celle-ci. Dans tous les cas, il faudra alors tenir compte des droits d’auteurs.

- Étudier la possibilité d’ajouter des visuels ou des textes sur le contenu manipulé pour informer clairement le public de la façon dont la vidéo a été altérée.

- Quel vocabulaire employer pour décrire ce type de désinformation ? Il peut être utile d’expliquer que le contenu est « retouché », « manipulé » ou « déformé », plutôt que de le désigner comme « faux ». Cela peut prêter à confusion pour les lecteurs, surtout lorsque la désinformation s’appuie sur des photos ou des vidéos authentifiées.

- Dans la mesure du possible, chercher à promouvoir la vérité, donc éviter de répéter ou d’amplifier des informations inexactes et d’employer un vocabulaire accusatoire dans les titres.

- Penser à présenter le contenu manipulé dans un contexte plus large en ce qui concerne les intentions, les motivations, les menaces et les préjudices.

- Avant de parler de mensonge, il convient d’expliquer pourquoi un contenu est faux et de fournir des preuves pour appuyer cette conclusion.

- Prendre soin de ne pas discréditer ou de ne pas se moquer de ceux qui croient au contenu manipulé pour éviter de renforcer leurs croyances.

CrossCheck est un projet unique de vérification collaborative de l’information en ligne, lancé le 6 février 2017 par First Draft, un réseau international d’organisations des secteurs médiatique, technologique et académique, avec le soutien du Google News Lab. Pour mieux comprendre les résultats de cette initiative, First Draft a demandé à des chercheurs de réaliser une analyse indépendante du projet. (Téléchargez le rapport ici.) Voici une synthèse de leur travail.

Présentation de CrossCheck

CrossCheck est un projet de journalisme collaboratif imaginé pour lutter contre la désinformation en ligne durant les dix semaines qui ont précédé l’élection présidentielle française de 2017. Il a regroupé 37 partenaires, parmi lesquels des rédactions, des universités, des organisations à but non lucratif, des entreprises du secteur technologique, dont Google et Facebook, ainsi que le public français, qui a soumis des questions.

CrossCheck a été conçu pour vérifier si une collaboration d’une telle ampleur pouvait améliorer les pratiques journalistiques en matière de suivi et de rectification des éléments de désinformation en ligne et rétablir un niveau de confiance plus élevé entre le public et les médias. Le projet a été récompensé par un prix de la Online News Association en octobre 2017.

Du 27 février au 5 mai 2017, plus d’une centaine de journalistes de 33 rédactions (dont 10 rédactions régionales) ont analysé les allégations et les rumeurs, ainsi que les images et les vidéos trafiquées qui circulaient sur les réseaux sociaux. Lorsque des informations trompeuses ou manipulées étaient largement diffusées en ligne, les participants élaboraient un article rectificatif, sous la supervision de l’Agence France-Presse (AFP), et la publiaient sur le site web de CrossCheck. Les rédactions partenaires couvraient aussi le sujet sur leur propre site et sur les réseaux sociaux. Ainsi, chaque article rectificatif touchait une audience beaucoup plus large que ne l’aurait fait une simple publication sur le site de CrossCheck.

Sur la durée du projet, 67 articles rectificatifs ont ainsi été publiés. Chaque article s’accompagnait d’une classification du contenu (par ex. : « vrai », « faux », « preuves insuffisantes », etc.) et d’une icône imaginée pour décrire le type de contenu (par ex. : « trompeur », « fabriqué », etc.). Il affichait également le logo des rédactions impliquées dans la procédure de vérification du contenu en question.

Principaux Résultats

Retombées pour les rédactions et les journalistes

- Les participants sont tombés d’accord sur le fait que ce type de travail ne devrait donner lieu à aucune concurrence et même être considéré comme un service public.

- Les journalistes engagés dans le projet ont indiqué avoir acquis de nouvelles compétences qu’ils mettent désormais à profit au sein de leur rédaction.

- La transparence de la méthode collaborative, qui impliquait de présenter son travail à d’autres rédactions, habituellement considérées comme concurrentes, a produit un journalisme de meilleure qualité. Les participants ont expliqué s’être responsabilisés les uns les autres.

- La prise de décision éditoriale collective a offert à des rédactions habituellement concurrentes la possibilité de décider ensemble des sujets à traiter et de ceux à ignorer pour ne pas alimenter de rumeurs.

- De manière générale, les contributions du public se sont avérées utiles et diversifi ées. Elles ont rappelé l’importance d’inclure le public dans les collaborations journalistiques futures.

Retombées pour le public

- Le fait que plusieurs rédactions collaborent entre elles a accru le niveau de confiance des personnes interrogées dans le traitement de l’information. Ces dernières lient l’indépendance, l’impartialité et la crédibilité imputées à CrossCheck au nombre d’organes de presse impliqués.

- Les explications relatives à la méthode utilisée pour vérifier une allégation ou un contenu ont inspiré une plus grande confiance et aidé le public à découvrir comment vérifier lui-même des informations.

- En plus d’avoir aiguisé son esprit critique, le public a également appris à faire preuve de réserve face aux contenus suscitant, par leur langage ou leur visuel, des réactions émotionnelles.

- Les personnes interrogées expliquent avoir partagé, aussi bien en ligne que hors ligne, des informations produites par CrossCheck avec des amis et des proches qui publiaient des informations inexactes relatives à l’élection. Certaines indiquent même les avoir ainsi fait changer d’avis quant à leur vote.

- Le fait que le projet regroupe des organes de presse régionaux semble constituer l’une des raisons pour lesquelles il a touché des personnes de tous horizons politiques. Son succès s’explique également par l’impartialité que le public lui a reconnu.

Considérations pour le futur

- La plupart des partenaires impliqués dans le projet ont tiré une véritable fierté de leur participation et sont prêts à réfléchir à une poursuite de leur collaboration.

- Des études supplémentaires doivent être réalisées pour identifier les manières les plus efficaces de produire des formats rectificatifs vidéos.

- Les rédactions ont réalisé la nécessité de mener une réflexion approfondie pour déterminer quand et comment couvrir ce type de sujets afin de ne pas jeter de l’huile sur le feu.

- Des tentatives similaires, lancées lors des élections au Royaume-Uni et en Allemagne, ont connu moins de succès en matière de collaboration entre rédactions. Il est donc essentiel de comprendre pourquoi CrossCheck a fonctionné en France à cette période spécifique.

Auteur: Ryan Watts, Alexandra Ma et Nic Dias

Les journalistes cherchent désormais à débusquer les fausses informations mais on lit beaucoup moins de choses sur les initiatives prises pour suivre ce dont les internautes parlent sur les médias sociaux, pour détecter la localisation géographique et la vitesse à laquelle les fausses informations circulent. Différents outils peuvent pourtant 1/ aider les journalistes à suivre les conversations en ligne en temps réel et 2/ être intégrés dans les procédures mises en place pour vérifier l’exactitude des faits et la véracité des informations.

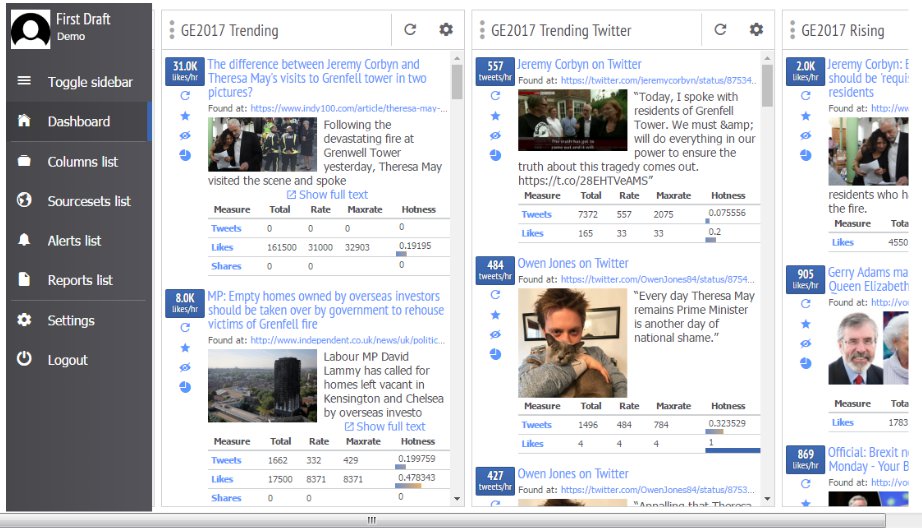

Durant le déroulement du projet Full Fact First Draft lors de la campagne des élections législatives en Grande Bretagne, nous avons suivi une grande quantité d’échanges en ligne pendant trente trois jours. Nous proposons ici une brève description de nos opérations au jour le jour pour proposer une méthodologie aux journalistes qui doivent réagir rapidement à des conversations en ligne liés à l’actualité et juguler un flot de désinformations.

Nos livrables

Dans le cadre du projet, les abonnés ont reçu un email deux fois par jour.

Nous avons produit deux lettres d’information quotidiennes, envoyées aux partenaires de notre rédaction chaque matin et chaque après-midi.

La lettre d’information du matin avait pour but de donner à nos partenaires des indications sur les conversations en cours liées à l’actualité et pour signaler les contenus sur les réseaux sociaux dont nous avions remarqué qu’ils gagnaient en popularité.

La lettre d’information de l’après-midi était principalement consacrée à la vérification des faits, à la clarification sur les publications mensongères sur les réseaux sociaux, au profilage des tendances en cours pouvant avoir des résonnances politiques, et à l’explication des différences entre ce que les rédactions des médias traditionnels couvraient et ce dont les communautés en ligne parlaient.

Les préparatifs

Avant d’envoyer notre première lettre d’information, nous avons consacré une semaine à compiler un recueil d’informations ‘fabriquées’ sur le Royaume-Uni, des sites satiriques aux blogs ultra partisans, en passant par les pages et groupes Facebook consacrés à la politique, aux fils de conversation sur Reddit et aux mots-clics sur Twitter qui, selon nous, devaient être suivis à l’aide d’outils mesurant la popularité des posts comme Trendolizer, CrowdTangle et Spike de NewsWhip. Ces listes ont été régulièrement mises à jour durant la campagne électorale. Le 8 juin, jour de l’élection, nous suivions 402 sources et sujets et avions collectés plus de 34 millions de tweets et 220 000 posts sur Facebook dans nos serveurs.

Trendolizer nous a aidés à repérer des contenu devenant viraux sur toutes les plateformes de réseaux sociaux en temps réel. L’outil nous a permis de mettre en place des recherches en utilisant une variété de paramètres, afin de trouver les posts pertinents et qui marchaient bien. Nous avons constitué une liste de mots-clés liés à l’élection pour les recherches et nous avons mis en place de multiples ‘colonnes’, à la manière de l’outil Tweetdeck, qui illustraient quel impact avaient les posts selon différents paramètres, tel que, par exemple, le nombre de partages durant une période de 24 heures. Lorsque nous avons introduit de nouveaux thèmes, nous avons ajouté des ‘colonnes’ distinctes pour ces sujets.

Capture d’écran de notre tableau de bord sur l’outil Trendolizer.

CrowdTangle, un outil de Facebook, nous a aidés à trouver des publications qui sur-performaient sur des pages Facebook particulières (par exemple, qui généraient plus d’interactivité que d’ordinaire sur cette page). Pour des statistiques plus détaillées sur les posts sur les réseaux sociaux ou les articles, nous avons choisi Spike de Newswhip, qui fait ressortir les articles les plus lus et fournit des projections fiables sur le taux futur et probable de partage.

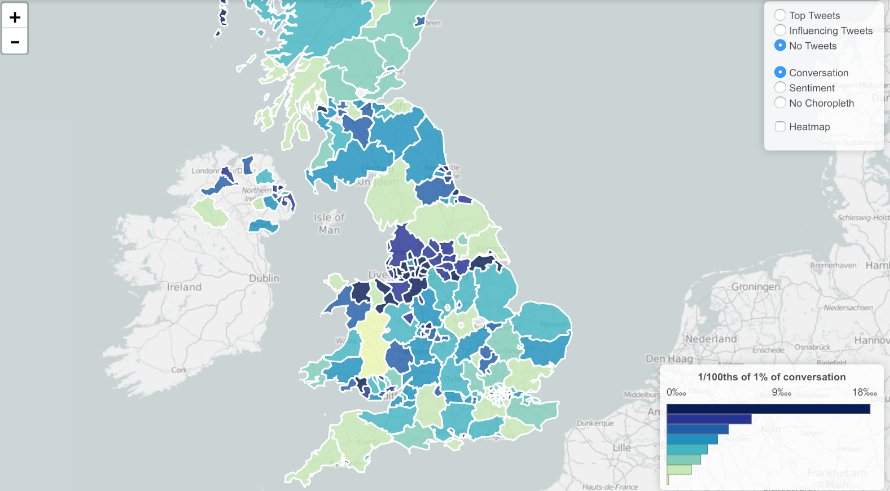

Pour suivre les méta conversations sur Twitter, faisant appel à de multiples mots-clics, nous avons utilisé Trendsmap, qui enregistre la croissance et la dispersion géographique de l’utilisation des mots-clics et des mots-clés sur Twitter. Cet outil nous a également été utile pour identifier les tweets à l’origine de tendances, et fournir des estimations brutes du minimum de comptes ‘robotisés’ qui avaient partagé ces tweets.

Trendsmap nous a permis de visualiser où des conversations précises avaient lieu géographiquement.

Nous n’avons pas pour autant négligé les sources traditionnelles d’informations. Chaque jour, nous avons suivi les Unes des journaux et écouté les grandes émissions d’information du matin (comme le programme Today, l’émission de Steve Allen sur LBC et Wake up to Money sur la BBC Radio 5) pour comparer la couverture des médias traditionnels et les conversations sur les réseaux sociaux.

Pour ‘aspirer’ les données des posts publics sur Facebook et Twitter, nous avons dédié un serveur à chacun de ces deux réseaux sociaux et avons commencé à collecter des données sur ces posts un mois avant le jour de l’élection.**

Notre serveur dédié à Facebook nous a permis d’identifier où et quand les pages et les groupes Facebook gravitaient autour de liens et sujets spécifiques. De plus, le serveur nous a permis d’analyser les différences de thématiques dans les conversations qui avaient lieu à différents ‘points’ du spectre politique. De façon plus générale, ces données ont donné de la versatilité à nos analyses quand besoin était.

Notre serveur dédié à Twitter a archivé de façon brute les tweets comprenant au moins un mot-clic ou nom de domaine préalablement identifiés. Ce qui s’est révélé pratique pour comparer la popularité de différents noms de domaine et mots-clics, ainsi que pour évaluer les rôles que les producteurs de contenus jouaient dans les Tendances. Notre champ d’exploration s’est régulièrement élargi en recherchant les nouveaux mots-clics dans notre base de données.

Ce qu’il faut retenir

1) Les statistiques sur la performance d’un post sur les réseaux sociaux, et non sur son contenu uniquement, peuvent être une source d’informations utiles pour les vérificateurs d’informations, les ‘fact checkers’. Au lieu de nous contenter d’affirmer qu’une déclaration était fausse, nous avons été en mesure d’évaluer l’importance d’un post en particulier dans un schéma ou une tendance plus large. Cet aspect est devenu d’une grande importance étant donné qu’il y a presque toujours eu trop de données à couvrir. Considérer la multitude de posts sur les réseaux sociaux avec une perspective déjà formée par les données sur le post nous a permis de fournir des analyses à valeur ajoutée aux partenaires de notre rédaction. Un exemple : quand une page Facebook nationaliste a posté une vidéo mensongère sur un attentat supposément commis par un réfugié, savoir en amont que ce contenu correspondait à une tendance de cette page à publier des posts similaires et produisait une échelle attendue de réactions nous a permis de juger qu’il n’était pas nécessaire de lui accorder trop d’attention.

2) La nature ultra rapide et débordante du travail de fact checking et de vérifications quotidiennes signifie que la vitesse est essentielle en matière d’outils analytiques. A noter : nos serveurs de récolte et stockage de données nous ont permis de les analyser d’une façon qui n’auraient pas été possible autrement et ils nous ont permis d’étayer plusieurs de nos articles. Mais comme les outils très maniables pour l’utilisateur tels que Trendsmap proposent une grande variété de paramètrages, il était plus efficace de les utiliser comme premier port d’attache, avant d’avoir recours à nos serveurs.

3) Avant tout, notre projet a fait ressortir qu’il est important de suivre les grandes tendances sur les réseaux sociaux et les schemas répétitifs repérés, ainsi que les posts et contenus uniques, alors que les salles de rédaction ont une tendance à figer. En identifiant des conversations en ligne plus larges, nous avons pu travailler sur les sujets que les électeurs actifs en ligne trouvaient les plus importants, comme le ‘vote tactique’, l’inscription sur les listes électorales et les problèmes sociaux – et non pas les négociations du Brexit, par exemple.

Appendice

* Nous avons volontairement voulu nous en tenir aux sujets suivants : Brexit, changement climatique, immigration, santé, défense, police et maintien de l’ordre, retraites, éducation. Après le commentaire de la Premier ministre Theresa May sur la chasse au renard, nous avons décidé d’ajouter le sujet de la chasse à nos thèmes. C’est ainsi que nous avons découvert que les conversations sur la chasse au renard et la cruauté envers les animaux ont perduré, même quand Theresa May a cessé de parler de sa position sur la chasse au renard.

** Pour ‘aspirer’ des posts des pages et groupes Facebook publics, nous avons adapté le code informatique écrit par Max Woolf. Nous avons conservé nos listes de pages et groupes à explorer par le code sur Google Sheets, qui a aussi fait office de ‘file d’attente’ pour nos scripts.

La possiblité de partager les fichiers Excel de Google Sheets a aussi permis aux membres de l’équipe d’ajouter des pages et des groupes à notre cycle de récoltes de données, dès qu’ils devenaient disponibles. Les posts récents étaient aspirés à nouveau à chaque heure, pour jauger la croissance des posts uniques. Un troisième script (programmé, là encore, à une fréquence horaire) préparait les données pour l’exportation sous forme de fichier compressé Zip téléchargeables à partir d’un simple serveur HTTP. Ceci a permis aux membres de l’équipe de télécharger des données Facebook récentes de façon autonome sans avoir à transférer les fichiers via le terminal.

Nous avons installé Social Feed Manager (SFM) sur un deuxième serveur, pour pouvoir collecter les tweets : Le SFM (Social Feed Manager) a, là encore, permis à ceux qui ne sont pas développeurs de pouvoir lancer, modifier et exporter des séries de données. Notre méthode primaire de récolte de données a été l’API de recherche, lancée à chaque heure. Cette méthode a été préférée à l’API Streaming, parce qu’elle nous permet d’éviter de perdre des données durant les changements de requêtes ou les problèmes de serveurs. Les clés API ont été générées par l’administrateur du serveur sur la base des besoins exprimés mais les journalistes ont aussi été autorisés à générer eux-mêmes des clés.

Informations sur les serveurs

Facebook – 8GB de RAM, 4 CPU, Disque 60GB SSD

Twitter – 16GB de RAM, 8 CPU, Disque 160GB SSD

Facebook et Google News Lab ont soutenu First Draft et Full Fact dans leur collaboration avec les rédactions des grands médias pour lutter contre les rumeurs et la désinformation répandues sur les réseaux sociaux durant les élections législatives au Royaume-Uni.

Ceci est le deuxième article de blog d’une série consacrée au projet Full Fact-First Draft à l’occasion des élections législatives au Royaume-Uni. Lire le premier post de blog sur les élections législatives au Royaume-Uni : “Ce que nous avons appris en travaillant avec Full Fact”

Lors d’une exposition à une expérience traumatisante, même à distance, le cerveau humain peut développer des symptômes de détresse similaires à ceux qui pourraient se manifester si vous vous trouviez sur place. En effet, il est programmé pour prendre des mesures visant à protéger la personne devant toute menace potentielle. Lors d’une situation inattendue, il évalue la situation et décide si nous sommes en sécurité ou si une réaction rapide est nécessaire. Des molécules comme le cortisol sont libérées dans notre corps pour nous préparer à l’action. Dans les situations extrêmes, les réactions possibles sont le combat, la fuite ou la paralysie. Si nous sommes exposés à de telles expériences dans la vie quotidienne, celles-ci peuvent se traduire par des agressions ou une irritabilité et/ou la fuite ou l’évasion, qui peuvent passer par la consommation d’alcool et de drogue ou l’isolement social et la dépression.

Même si ces mécanismes sont parfois faibles ou imperceptibles, ils peuvent produire un effet cumulatif. Un traumatisme indirect peut se construire avec le temps et même de petites libérations de ces substances naturelles dans votre corps peuvent affecter votre état de santé.

Si vous avez vécu des expériences difficiles par le passé, celles-ci peuvent influencer et intensifier vos réactions face à des images traumatisantes. Il est aussi possible que vous réagissiez à une situation qui vous rappelle une personne que vous connaissez. De la même façon, si vous ressentez un stress dans d’autres aspects de votre vie, ou au travail, vous pourriez être plus sensible au traumatisme indirect, car votre sentiment de sécurité est déjà compromis

Symptômes à surveiller

Il est aisé de minimiser les signes de traumatisme indirect et de supposer qu’il s’agit de symptômes insignifiants et temporaires. Un tel cas est possible, toutefois, si vous êtes régulièrement confronté à des situations professionnelles qui peuvent potentiellement provoquer de telles réactions ou si vous avez vécu une expérience particulièrement dérangeante, il est important de surveiller attentivement vos réactions à long terme, de considérer leurs impacts et les changements qui s’opèrent.

SIGNES PSYCHOLOGIQUES

Pensées et images intrusives s’imposant contre votre gré

Attentes personnelles irréalistes

Cynisme

Désespoir, perte d’idéal

Culpabilité par rapport à votre propre survie/plaisir

Colère

Dégoût

Peur

Troubles du sommeil ou cauchemars

Problèmes de concentration

Se laisser facilement surprendre

Apathie

Incapacité à tolérer de fortes émotions

Sensibilité accrue à la violence

COMPORTEMENT ET RELATIONS

Frontières : difficulté à séparer vie professionnelle et vie personnelle ou sentiment de distance avec les autres, même lorsque vous communiquez avec eux

Mise en retrait : isolement social et privation d’activités habituellement plaisantes

Humeur : irritabilité, intolérance, agitation, impatience, manque d’affection

Échappatoires (ou dépendances) impliquant la nicotine, l’alcool, la nourriture, d’autres substances, le sexe, les achats, Internet

SIGNES PHYSIQUES

Migraines

Fatigue sans raison évidente

Troubles gastro-intestinaux

Changement de l’appétit

Comment se protéger ?

La prise de conscience représente une première étape essentielle dans la compréhension de la situation vécue et des pratiques pour prendre soin de soi sur le moment et à plus long terme. Bien que cela puisse paraître illogique, il est nécessaire de pleinement prendre conscience de l’expérience vécue. Surveillez toute modification de votre humeur, de votre comportement, de vos interactions, de vos sensations physiques ou de votre santé.

Ne refoulez pas vos sentiments, considérez-les avec une saine curiosité afin de vous accorder l’espace nécessaire pour faire des choix réfléchis à propos de vos besoins et du soutien que vous pourriez solliciter.

Il est important que les personnes qui travaillent dans un environnement présentant un risque de traumatisme indirect prennent les mesures nécessaires pour respecter leurs besoins de base, notamment concernant l’équilibre entre le travail, les loisirs, le repos et l’alimentation, et pour diversifier les tâches dans leur travail.

Je présente certains symptômes, que faire ?

- Observez la situation et mettez des mots sur ce que vous ressentez.

- Accordez-vous du temps pour assimiler les situations vécues.

- Tournez-vous vers des personnes de confiance (expliquez-leur ce que vous traversez, ce que vous ressentez et les symptômes qui se sont déclarés).

- L’humour noir n’est pas inhabituel dans les rédactions. Toutefois, si vous remarquez qu’un cynisme plus fort s’installe, prenez des mesures pour retrouver un sens et un optimisme en vous reconnectant à vos valeurs.

- Accordez-vous du temps pour méditer ou effectuer des exercices de respiration relaxants.

- Essayez des techniques d’ancrage.

- Essayez des techniques de redirection de l’attention. Il ne s’agit pas de refouler ou de réprimer vos pensées ou vos émotions, mais d’orienter consciemment votre attention sur différents éléments.

- Dès que vous estimez vous trouver dans une situation présentant un risque élevé de traumatisme indirect, parlez à vos collègues et demandez-leur de surveiller tout signe visible d’aggravation. Informez votre supérieur de la situation que vous traversez et parlez avec celui-ci et avec vos collègues si vous avez besoin de soutien supplémentaire.

Outils et techniques d’autogestion

FORMULE « PEACE »

La formule « PEACE » (pour Pace, Energy, Accepting/Adapting, Choice, Esteem) constitue une technique que vous pouvez utiliser pour faire régulièrement le point sur votre relation à ce qui vous entoure et à vous-même. Il s’agit de vous assurer directement de faire les bons choix en matière d’utilisation de votre temps et de votre énergie. Lorsque vous travaillez sur des sujets difficiles, prenez du recul et posez-vous les questions suivantes :

ALLURE : À quelle vitesse est-ce que je vais ? Est-ce que je peux continuer à ce niveau d’intensité ? Est-ce que je dispose de temps pour réfléchir et récupérer ?

ÉNERGIE : Quels sont mes schémas d’énergie ? Est-ce possible de m’organiser pour traiter les sujets les plus difficiles quand je dispose du plus d’énergie et de ressources ? Est-ce que j’écoute mon corps lorsque mon énergie est plus faible ?

ACCEPTER et s’ADAPTER : Si je vis une expérience difficile ou si je suis vaguement conscient de problèmes, quels éléments dois-je peut-être accepter que j’ai peut-être jusque-là refusé d’identifier ? Comment puis-je m’adapter pour prendre en compte mes besoins afin d’être plus résistant sur le long terme ?

CHOIX : Sur quels éléments est-ce que je peux diriger mon attention ? Que puis-je choisir de mettre de côté (peut-être temporairement) ? Qu’est-ce que je souhaite demander comme soutien ?

ESTIME : Quel type de message je m’adresse ? Par exemple, est-ce que vous vous reprochez d’avoir les problèmes que vous rencontrez ? Est-ce que je peux me rappeler que je suis bon dans mon travail et que je ne suis pas en train d’échouer, mais de prendre soin de ma résilience générale ?

Techniques de respiration et autres outils de pleine conscience

Vous concentrer sur votre respiration peut vous aider à vous calmer, à réguler vos réactions physiques et à vous donner un sentiment d’ancrage. Voici quelques façons de faire :

Technique de respiration 7/11 : inspirez en comptant jusqu’à 7 et expirez en continuant jusqu’à 11, puis répétez jusqu’à sentir que vous reprenez le contrôle. Puis, continuez simplement en suivant le rythme habituel de votre respiration.

La création d’un espace de respiration en 3 étapes peut être utilisée avant, pendant ou après une tâche difficile ou un moment de travail difficile :

Préparez-vous en fermant ou en baissant les yeux et prenez conscience du contact de votre corps avec le sol et avec votre siège. Pensez à la position de vos pieds et de votre dos, et adoptez une position dans laquelle vous vous sentez alerte et digne.

Étape 1

Observez et nommez votre humeur du moment. Explorez et nommez toutes les émotions présentes. Écoutez et nommez toutes les sensations de votre corps.

Étape 2

Concentrez toute votre attention sur votre respiration. Conscientisez chaque respiration : l’air qui entre dans votre corps, se déplace vers votre ventre et remonte. Continuez pendant une minute environ en vous focalisant simplement sur votre respiration.

Étape 3

Étendez votre conscience à l’intégralité de votre corps, comme si vous respiriez par les pores de votre peau.

Pour terminer les exercices de respiration, remarquez une fois de plus le contact de votre corps avec votre siège et de vos pieds au sol. Laissez progressivement la lumière filtrer à travers vos paupières et soulevez-les pour vous ouvrir à nouveau au monde extérieur.

Ancrage

Cette technique vous aide à faire travailler votre esprit et votre corps ensemble dans le moment présent. Elle est particulièrement utile lorsque vous vous sentez dépassé. Essayez toute combinaison des éléments suivants : concentrez-vous cinq secondes sur cinq objets qui vous entourent ; concentrez-vous sur le contact de votre corps avec votre siège et/ou le sol ; tenez une boisson chaude ou fraîche entre vos deux mains et concentrez-vous sur la température ; humez un plat, une fleur ou tout autre objet ; passez-vous de l’eau sur le visage ; énoncez à haute voix votre nom, votre âge, le lieu où vous êtes et où vous serez plus tard dans la journée ; levez-vous et marchez, faites attention à chaque pas ; concentrez votre attention sur les bruits, d’abord ceux à proximité, puis ceux plus éloignés et enfin ceux qui proviennent de l’extérieur de la pièce.

Redirection de l’attention

Remémorez-vous une image qui vous rassure. Puis, en toute conscience, passez de celle-ci à celle qui vous pose problème. Parlez-vous en faisant cela. Rappelez-vous que ce n’est pas un exercice visant à refouler une situation, mais à exercer un contrôle sur celle-ci.

Créez des rituels qui vous aident à prendre pleinement conscience du moment où vous commencez à travailler et où vous vous arrêtez.

Aujourd’hui, nous reconnaissons tous que le terme fake news, particulièrement répandu en anglais et toujours plus utilisé en français pour désigner des fausses informations, ne s’avère pas très utile. Cependant, sans qualificatif pour le remplacer, nous sommes contraints à employer cette formule en mimant des guillemets. Trouver une expression de remplacement n’est pas chose aisée, car il s’agit d’évoquer bien plus que des simples actualités. En effet, il est question de l’ensemble de l’écosystème de l’information. En outre, « fausse » ne saurait décrire la complexité des différents types de mésinformation (partage malencontreux d’informations incorrectes) et de désinformation (création et partage délibérés d’informations fausses).

Pour comprendre le système actuel de l’information, nous devons considérer trois éléments :

- Les différents types de contenus créés et partagés

- Les motivations des personnes à l’origine de ces contenus

- Les modes de diffusion de ces contenus

Le sujet est important. Comme l’a souligné récemment Danah Boyd dans un article, nous sommes en guerre. Il est évident que nous devons nous préoccuper des personnes (parmi lesquelles des journalistes) qui partagent involontairement de fausses informations. Toutefois, les campagnes de désinformation systématiques soulèvent bien plus d’inquiétudes. Les tentatives antérieures d’influencer l’opinion publique reposaient sur des technologies de diffusion traditionnelles, mais avec les réseaux sociaux les éléments de propagande ciblent directement les utilisateurs les plus à même de recevoir et de partager un message spécifique.

Lorsqu’une personne partage un article, une image, une vidéo ou un mème portant à confusion ou fabriqué de toutes pièces, sans se rendre compte qu’il ne s’agit pas d’une information fiable, elle suscitera probablement la confiance chez l’internaute suivant qui verra passer l’information dans son flux d’actualités et la repartagera. Ainsi, les éléments d’information se diffusent à grande vitesse grâce aux réseaux pair-à-pair reposant sur des relations de confiance. Cela est bien plus inquiétant que les sites de fausses informations développés par des adolescents macédoniens à la recherche de profits.

Les différents types de mésinformation et de désinformation

En novembre, je m’exprimais à propos des différents types d’informations problématiques dont je constatais la diffusion dans le cadre de l’élection aux États-Unis. Depuis, j’ai essayé d’établir une typologie (et je remercie Global Voices qui m’a aidée à approfondir mes définitions). Je distingue sept types de contenus problématiques dans notre écosystème de l’information, qui correspondent à une échelle de mesure approximative de l’intention de tromper l’audience.

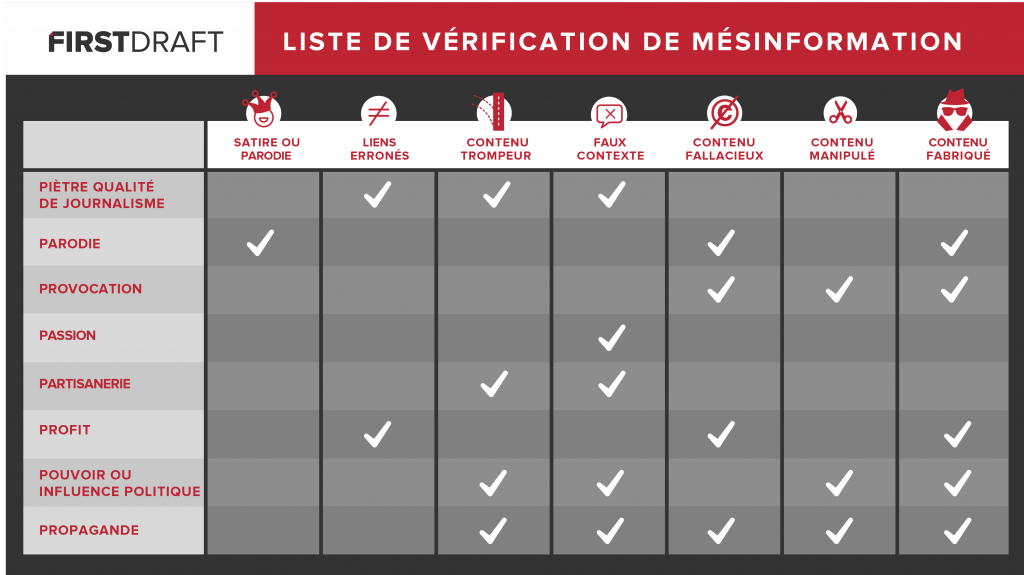

Quelles raisons poussent à fabriquer de telles publications ?

Si nous souhaitons réellement trouver des solutions à ces problèmes, nous devons étudier les personnes à l’origine de telles informations et leurs motivations.

Début janvier, j’ai assisté à une présentation d’Eliot Higgins à Paris au cours de laquelle il a dressé la liste de quatre « P » qui aident à expliquer l’origine de ces contenus. En étudiant cette liste, j’ai identifié et ajouté quatre éléments supplémentaires, établissant une nouvelle liste : piètre qualité de journalisme, parodie, provocation, passion, partisanerie, profit, pouvoir ou influence politique et propagande.

C’est un travail en cours, mais dès lors que l’on commence à analyser ces catégories et à tisser des liens entre elles, des profils distincts se dessinent en matière de types de contenu créés et de raisons spécifiques à leur fabrication.

Mécanismes de diffusion

Enfin, nous devons réfléchir à la manière dont ce contenu est relayé. Des informations sont partagées sur les réseaux sociaux sans mauvaise intention par des personnes qui ne les vérifient pas. D’autres sont amplifiées par des journalistes qui subissent une pression plus forte que jamais pour essayer de comprendre et de couvrir avec précision des informations publiées sur les réseaux sociaux en temps réel. D’autres encore sont publiées par des groupes faiblement connectés qui tentent délibérément d’influencer l’opinion publique et, enfin, certaines sont diffusées dans le cadre de campagnes de désinformation sophistiquées, au moyen de réseaux de robots et de groupes de propagande. (Comme vous pouvez le remarquer, il faut que je développe une matrice 3D pour mapper mon graphique en comparaison aux différents mécanismes de diffusion).

Comme le souligne cet article de Buzzfeed (en anglais), un groupe d’adolescents étasuniens sympathisants de Donald Trump, s’est réuni en ligne pour influencer l’élection française d’avril. Ils possèdent des dossiers partagés contenant des matrices de mèmes, afin que même les non-francophones puissent publier des visuels dans les flux de hashtags. Il est désormais incroyablement aisé pour les groupes faiblement connectés de se mobiliser et d’utiliser des outils gratuits pour coordonner des échanges de message privés.

Lorsque la publication est coordonnée et cohérente, il est aisé de tromper nos esprits, déjà épuisés et toujours plus dépendants de l’heuristique à cause de la quantité accablante d’informations qui nous arrivent au quotidien. Lorsque nous recevons plusieurs messages sur un même sujet, notre cerveau considère cela comme un gage de crédibilité. Une information lue plusieurs fois dans une même journée est souvent considérée vraie.

Nous sommes nettement moins susceptibles de faire preuve d’esprit critique devant des informations visuelles ou renforçant nos opinions. Et, comme l’excès d’informations épuise nos cerveaux, nous sommes beaucoup plus faciles à influencer.

Comment pouvons-nous agir ?

Nous jouons tous un rôle crucial dans cet écosystème. Chaque fois que nous acceptons une information passivement ou que nous partageons une publication, une image ou une vidéo sans la vérifier, nous participons au bruit et à la confusion. L’écosystème de l’information est tellement pollué que nous devons prendre nos responsabilités et vérifier de manière indépendante le contenu que nous rencontrons en ligne.

Au cours des semaines qui ont suivi l’élection présidentielle américaine, des journalistes ont traqué des créateurs de fausses informations et se sont entretenus avec eux. Au cours de leurs discussions, une constante s’est dessinée : ils expliquaient avoir tenté de fabriquer des informations qui duperaient les personnes de gauche et avoir échoué. À ce propos, Jestin Coler a indiqué à NPR : « Nous avons essayé de faire de même avec les libéraux. Cela n’a jamais fonctionné, ça ne prend jamais. Les informations étaient démenties dans les deux premiers commentaires, puis l’ensemble tombait à l’eau. »

Cependant, l’avantage des libéraux à ce sujet fut de courte durée. Depuis l’investiture du président Trump, nous constatons que les deux camps se font berner et partagent de fausses informations. Qu’il s’agisse des comptes Twitter que personne n’a réussi à vérifier de manière indépendante, du générateur de mèmes des décrets présidentiels de Donald Trump, des internautes qui retweetent une publication du compte parodique de Jill Stein en espérant désespérément que ce soit authentique ou des affirmations indiquant que le vice-président Pence a supprimé un tweet qui condamnait le décret interdisant l’admission de ressortissants de certains pays musulmans alors qu’il était encore présent dans son fil d’actualité depuis décembre, la gauche démontre les mêmes faiblesses que la droite. Lorsqu’ils sont fâchés et qu’ils ont peur, les individus font preuve de moins d’esprit critique.

Invité dans l’émission de radio On The Media, Craig Silverman s’est exprimé sur le besoin de faire preuve de scepticisme émotionnel. Je suis totalement d’accord. Il ne s’agit pas uniquement de développer plus de projets d’éducation à l’information, mais d’apprendre aux gens à douter de leurs réactions instinctives. Si un élément d’information vous fâche terriblement ou vous ravit (car il réaffirme votre point de vue), réexaminez-le.

S’’il est conseillé d’attendre 20 minutes avant de se resservir de nourriture, le temps que notre estomac communique avec notre cerveau, il en va de même au sujet de l’information. Il n’est peut-être pas nécessaire d’attendre 20 minutes avant de partager un contenu, mais deux minutes semblent raisonnables.

Nous vivons une époque cruciale. Si nous voulons réellement comprendre la situation dans laquelle nous nous trouvons, nous devons en saisir la gravité et comprendre ce contre quoi nous luttons. Utiliser l’expression fake news à tout bout de champ, même en y ajoutant des guillemets, ne nous mènera nulle part.

Si ce sujet vous intéresse, n’hésitez pas à consulter la liste d’articles en anglais que je vous recommande et que j’alimente régulièrement.